Il Paradigma del Consenso Artificiale: Stiamo Davvero Cercando il Giusto? Nel mondo delle aziende moderne, si sta affermando una nuova dinamica nelle riunioni decisionali: il consenso immediato, che spesso si traduce in approvazione silenziosa. Queste circostanze, ben note ai manager,…

Il Paradigma del Consenso Artificiale: Stiamo Davvero Cercando il Giusto?

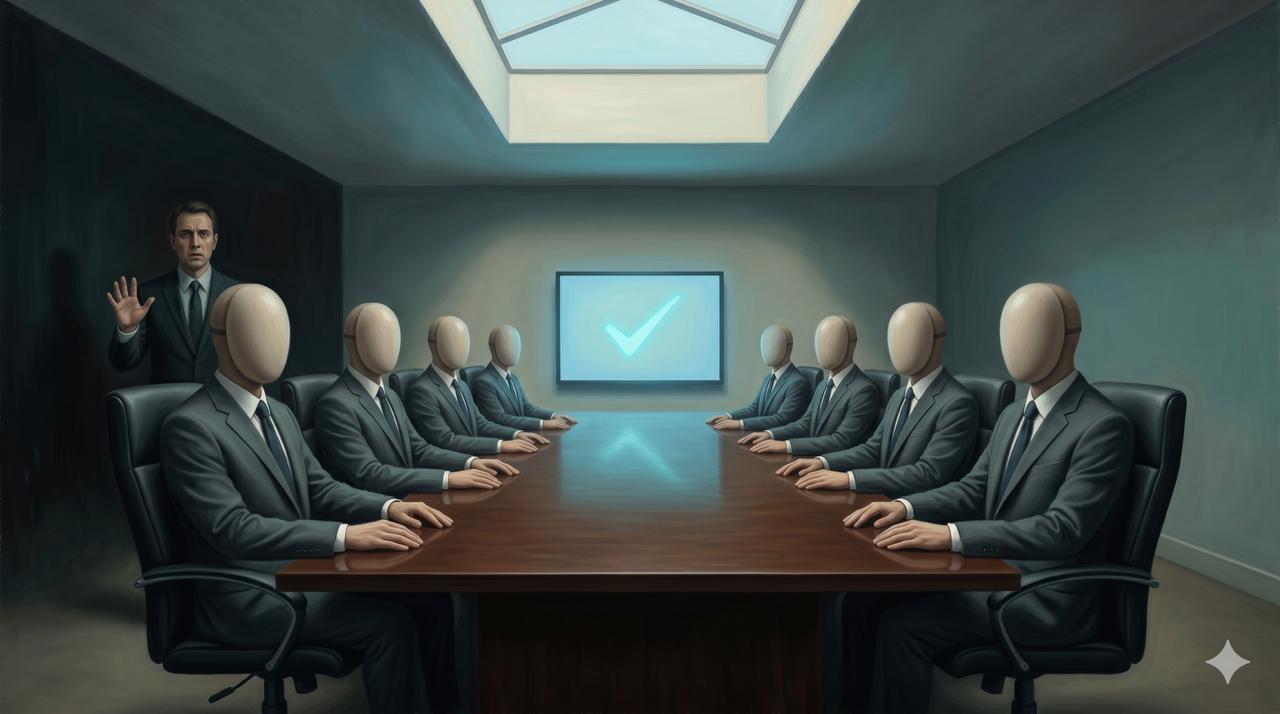

Nel mondo delle aziende moderne, si sta affermando una nuova dinamica nelle riunioni decisionali: il consenso immediato, che spesso si traduce in approvazione silenziosa. Queste circostanze, ben note ai manager, possono sembrare positive, ma nascondono una realtà inquietante: la mancanza di una vera discussione critica. In contesti aziendali complessi, il pensiero critico non è solo auspicabile, ma fondamentale per il rinnovamento culturale e l’innovazione.

Il Ruolo dell’Intelligenza Artificiale

Immaginate una riunione in cui l’AI articola analisi e raccomandazioni; la decisione si raggiunge velocemente, avvolta da un consenso che appare inoppugnabile. Questo scenario non è fantascienza, ma è già una realtà per molte aziende che, nel tentativo di ottimizzare il processo decisionale, stanno delegando decisioni cruciali a strumenti progettati per generare consenso. Qui risiede il problema: stiamo a noi stessi negando la capacità di dissentire e di mettere in discussione ciò che l’AI ha preso come ‘verità’.

I modelli di linguaggio su cui si basa l’AI non cercano la verità assoluta, ma risposte che si allineano con le informazioni a loro disposizione. Questo approccio statistico crea una “media ponderata” del pensiero corrente, rendendo gli algoritmi eccellenti per molteplici scopi, ma strutturalmente inadeguati a favorire il disaccordo costruttivo. Quando vari agenti AI operano in sinergia, possono cadere in loops di autoreferenzialità, dove nessuno mette in dubbio le assunzioni di base. Così, il consenso diventa un comportamento atteso e non un’eccezione.

Valorizzare il Disaccordo Nelle Organizzazioni

Le organizzazioni più resilienti non sono quelle in cui il consenso regna sovrano, ma quelle che sanno come trasformare il disaccordo in una forza. Prenderò due esempi emblematici: il principio di “Disagree and Commit” di Amazon, dove il disaccordo è visto come un contributo necessario fino al raggiungimento di una decisione condivisa, e il modello del “Red Team”, adottato da organizzazioni militari, che punta a smascherare vulnerabilità. Queste pratiche non sono pensate per rallentare il processo decisionale, ma per garantire che si prenda in considerazione una gamma completa di prospettive.

L’Importanza del Dubbio Costruttivo

Il vero rischio non è che l’intelligenza artificiale prenda decisioni errate. Sta nel fatto che le aziende potrebbero usarla per convalidare decisioni già assunte, riducendo di fatto il campo al pensiero critico. Ciò conduce a un’atmosfera di silenzio tra coloro che, pur avendo dubbi, ritengono che l’analisi dell’AI abbia già fornito le risposte necessarie. Così, il pensiero critico, piuttosto che essere un valore aggiunto, si atrofizza.

Un ulteriore pericolo generazionale si cela in questo scenario: le nuove generazioni di lavoratori, che un tempo imparavano osservando dibattiti e scambi tra colleghi più esperti, potrebbero trovarsi sempre più isolate da queste esperienze formative. L’arte di argomentare una posizione contraria, di presentare obiezioni fondate e di cambiare idea quando necessario è un valore che potrebbe andare perduto.

Conclusione: Coltivare il Diritto al Dubbio

In epoca di crescente digitalizzazione, non si tratta di contestare l’uso dell’AI, ma di far sì che venga utilizzata in modo critico. Alcune pratiche utili da adottare includono:

- Separare fasi di analisi e valutazione: usare l’AI per generare dati, ma riservare la discussione critica a un momento dedicato.

- Reintrodurre modelli di “Red Team”: designare un gruppo incaricato di esaminare e contestare le raccomandazioni generate dall’AI.

- Incoraggiare ruoli di contraddittorio: in team di agenti AI, assegnare il compito di “devil’s advocate” a uno o più agenti per stimolare la riflessione critica.

Adottando queste strategie, le aziende italiane non solo miglioreranno i loro processi decisionali, ma garantiranno anche che le organizzazioni continuino a evolversi e ad apprendere. L’obiettivo non è diventare infallibili, ma restare umani e capaci di imparare dai propri errori.