Google Cloud presenta due nuove unità di elaborazione AI per sfidare Nvidia In un'ottica di crescita e innovazione nel settore dell'intelligenza artificiale, Google Cloud ha appena rivelato la sua ottava generazione di chip progettati su misura, noti come TPU (Tensor…

Google Cloud presenta due nuove unità di elaborazione AI per sfidare Nvidia

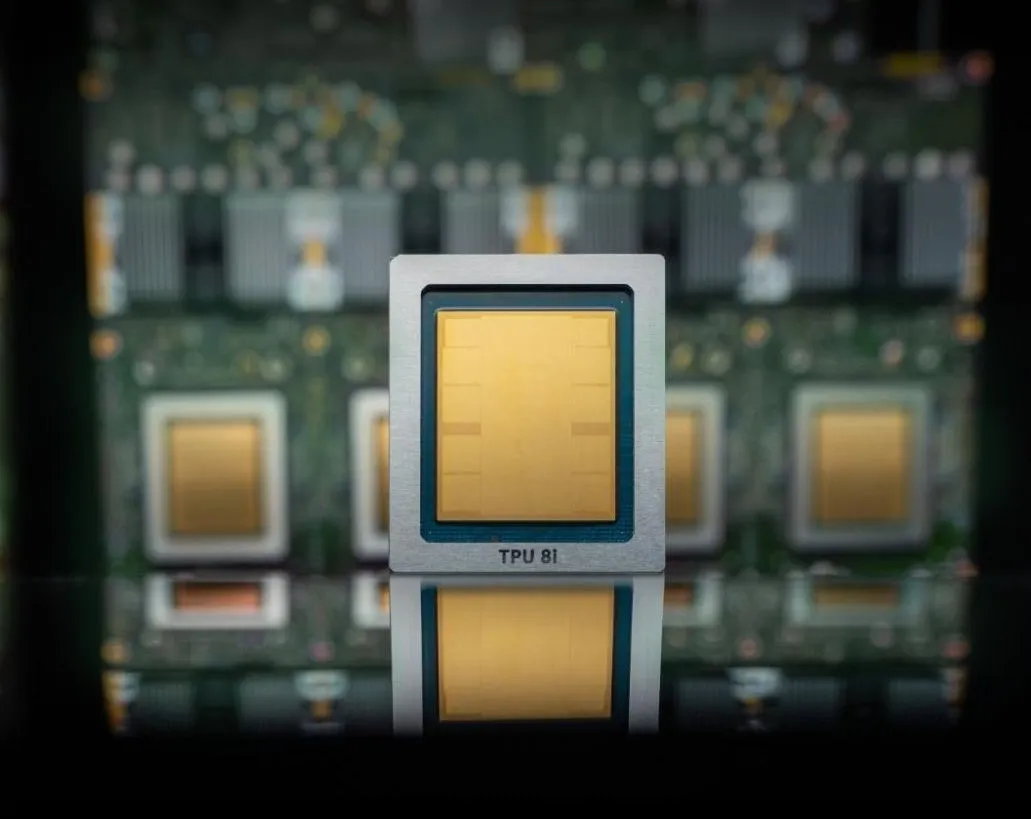

In un’ottica di crescita e innovazione nel settore dell’intelligenza artificiale, Google Cloud ha appena rivelato la sua ottava generazione di chip progettati su misura, noti come TPU (Tensor Processing Units). Questi nuovi chip, presentati mercoledì, si suddivideranno in due modelli: il TPU 8t, dedicato all’addestramento dei modelli, e il TPU 8i, focalizzato sull’inferenza, ossia l’applicazione pratica dei modelli dopo l’inserimento delle richieste da parte degli utenti.

Specifiche tecniche promettenti

Google ha messo in evidenza performance sorprendenti per i suoi nuovi TPU. Secondo l’azienda, questi chip riusciranno a ridurre i tempi di addestramento dei modelli di intelligenza artificiale fino a tre volte rispetto alle versioni precedenti. Inoltre, promettono un incremento dell’80% delle prestazioni per ogni dollaro speso, con la possibilità di mettere in rete oltre un milione di TPU in un unico cluster. Questi miglioramenti potrebbero tradursi in un notevole risparmio energetico e una riduzione dei costi per le aziende che scelgono di utilizzare i servizi di Google Cloud.

Un aspetto da notare è la scelta di Google di mantenere il termine TPU, piuttosto che GPU (Graphic Processing Unit), per sottolineare la natura personalizzata dei suoi chip a bassa potenza, che sono stati originariamente concepiti per l’elaborazione dei tensor.

Una strategia cauta e collaborativa

Nonostante le potenzialità dei nuovi chip, non si può dire che Google stia lanciando una sfida diretta a Nvidia. Al contrario, come altre grandi aziende del settore come Microsoft e Amazon, Google utilizza i suoi TPU per integrare e migliorare i sistemi esistenti basati sui chip Nvidia. In effetti, Google prevede di rendere disponibili nel suo cloud i più recenti chip di Nvidia, il Vera Rubin, entro la fine dell’anno. Questo approccio evidenzia una strategia di collaborazione piuttosto che di competizione aperta.

La crescita delle grandi aziende nel settore cloud computing, come Google, Amazon e Microsoft, potrebbe in futuro ridurre la loro dipendenza da Nvidia. Tuttavia, al momento attuale, scommettere contro Nvidia sembra essere una scelta azzardata. Gli analisti del settore, come Patrick Moorhead, hanno già sottolineato come le previsioni di un potenziale crollo per Nvidia non si siano avverate, vista la continua crescita della valutazione di mercato della compagnia, che si avvicina ai 5 trilioni di dollari.

Sinergie e futuro dell’IA

Una committenza da sottolineare è quella tra Google e Nvidia per ottimizzare le performance di rete dei sistemi Nvidia nel cloud di Google. Le due aziende collaborano per potenziare Falcon, un sistema di networking basato su software lanciato da Google nel 2023 e reso open source. Questa iniziativa si inserisce nel contesto dell’Open Compute Project, un’organizzazione che promuove soluzioni di hardware per data center aperte e collaborative.

Conclusione pratica

Per le aziende italiane che operano nell’ambito dell’intelligenza artificiale e del cloud computing, l’introduzione di questi nuovi chip da parte di Google rappresenta un’opportunità per ottimizzare i propri costi e migliorare le prestazioni dei modelli di intelligenza artificiale. Con un occhio attento all’evoluzione del mercato e una strategia aperta al dialogo con altri giganti tecnologici, Google potrebbe riuscire a fornire strumenti sempre più performanti, contribuendo a una trasformazione significativa nel panorama digitale italiano.