Google Lancia Nuovi Chip AI per Supportare l'Era degli Agenti Intelligenti Durante il recente evento Cloud Next, Google ha svelato due innovativi chip AI, chiamati TPU 8t e TPU 8i, progettati per rispondere alle crescenti esigenze di elaborazione richieste dai…

Google Lancia Nuovi Chip AI per Supportare l’Era degli Agenti Intelligenti

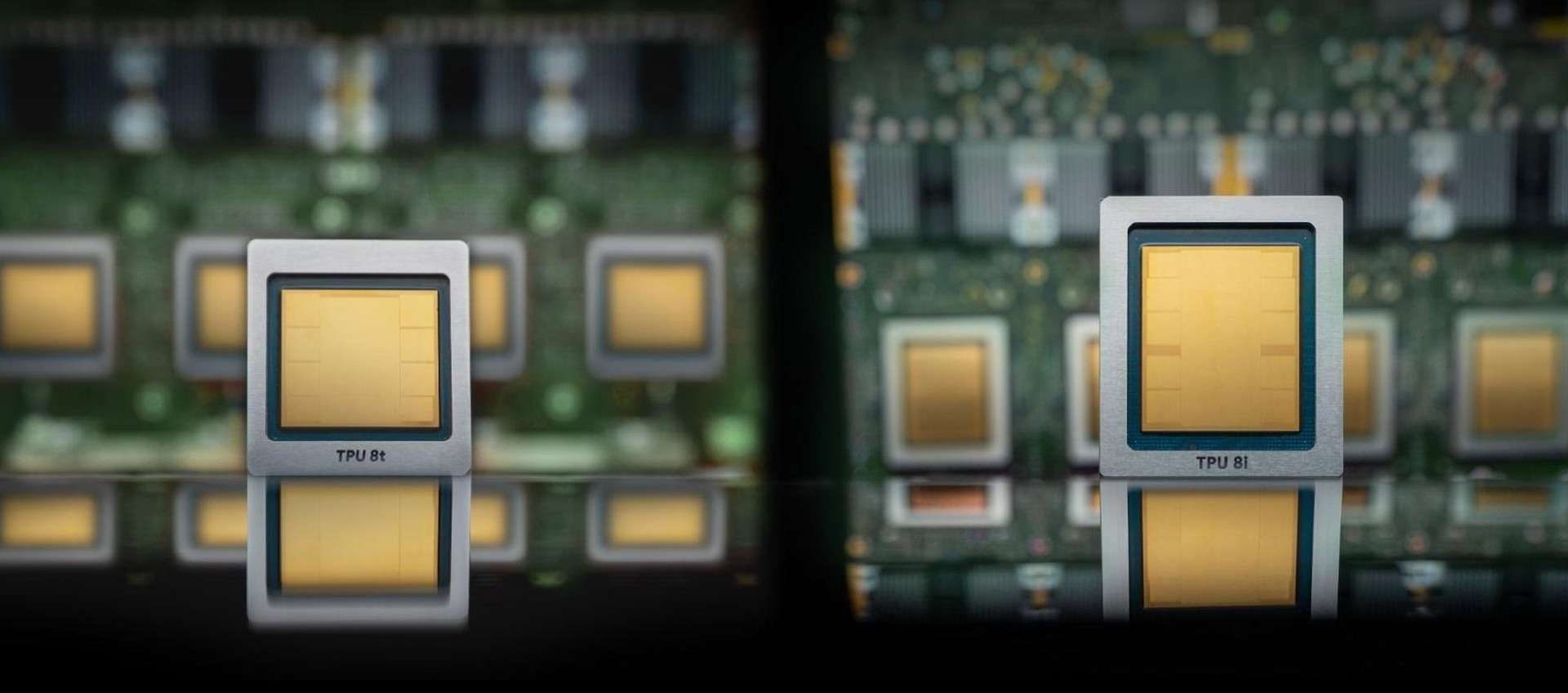

Durante il recente evento Cloud Next, Google ha svelato due innovativi chip AI, chiamati TPU 8t e TPU 8i, progettati per rispondere alle crescenti esigenze di elaborazione richieste dai flussi di lavoro agentici. Queste TPU di ottava generazione si posizionano come colonne portanti nei supercomputer destinati all’addestramento e all’inferenza dei modelli di intelligenza artificiale, inclusi i futuri sistemi come Gemini. Un aspetto chiave è che anche aziende terze potranno avvalersi di queste tecnologie avanzate.

Tecnologia Avanzata per Trasformare i Flussi di Lavoro

Con la crescente diffusione di agenti AI che svolgono compiti complessi, Google riconosce l’urgenza di potenziare le capacità di elaborazione in parallelo. Le nuove TPU 8t e 8i sono state progettate proprio per questa funzione cruciale. Grazie a miglioramenti significativi nelle prestazioni e nell’efficienza energetica, saranno in grado di supportare flussi di lavoro notevolmente più complessi rispetto alla generazione precedente (Ironwood).

Dettagli Tecnici delle TPU 8t e 8i

Il TPU 8t è concentrato sull’addestramento dei modelli AI, offrendo un potenziale straordinario. Un superpod può integrare fino a 9.600 chip, raggiungendo una capacità di calcolo di 121 ExaFlops, fornendo così prestazioni quattro volte superiori rispetto ai chip Ironwood. Un altro miglioramento significativo riguarda la larghezza di banda inter-chip, che è stata raddoppiata, arrivando a 19,2 Tb/s, mentre la rete offre una larghezza di banda di 400 Gb/s, quadrupla rispetto alla generazione precedente.

D’altro canto, il TPU 8i è progettato per l’inferenza, ottimizzando i tempi di risposta alle domande degli utenti. Ogni chip ha ora a disposizione 288 GB di High Bandwidth Memory e 384 MB di SRAM, che rappresentano un incremento notevole (il triplo rispetto alla generazione Ironwood). Un superpod per TPU 8i può ospitare fino a 1.152 chip. Entrambi i chip beneficiano di una gestione potenziata dell’alimentazione, capace di ottimizzare il consumo energetico in base alle necessità in tempo reale, portando a un aumento delle prestazioni per watt fino a due volte rispetto ai predecessori.

Implicazioni per il Mercato Italiano

L’entrata di queste nuove tecnologie nel mercato avrà un impatto significativo anche per le aziende italiane. Imprese e startup che si occupano di intelligenza artificiale e machine learning potrebbero beneficiare di una potenza di calcolo mai vista prima, aprendo a nuove possibilità di innovazione e sviluppo. La disponibilità prevista di TPU 8t e 8i entro la fine del 2026 offre un’opportunità per le aziende italiane di prepararsi e adattarsi a questa trasformazione.

In un’epoca in cui il ritmo del progresso tecnologico è incessante, i nuovi chip di Google rappresentano un passo fondamentale verso la creazione di intelligenze artificiali sempre più sofisticate e capaci di risolvere sfide complesse, rendendo la tecnologia più accessibile e utile per tutti.

Conclusione

In sintesi, l’annuncio di Google riguardo ai chip TPU 8t e 8i segna una pietra miliare per l’industria dell’AI. Con avanzamenti significativi nelle prestazioni e nell’efficienza energetica, queste tecnologie non solo supporteranno la crescita della compagnia, ma influenzeranno anche in modo positivo il panorama tecnologico italiano. Gli sviluppatori e le aziende potranno sfruttare tali innovazioni per sviluppare applicazioni avanzate, aprendo la strada a un futuro ricco di opportunità per l’intelligenza artificiale nel nostro paese.