L'AI Act rimane rigido: mancano accordi in Europa Il continuo dibattito sull'AI Act, la legislazione europea che regola l'intelligenza artificiale, ha subito un importante stop. Il 29 aprile scorso, dopo dodici ore di discussioni intense, i negoziatori dell’Unione Europea non…

L’AI Act rimane rigido: mancano accordi in Europa

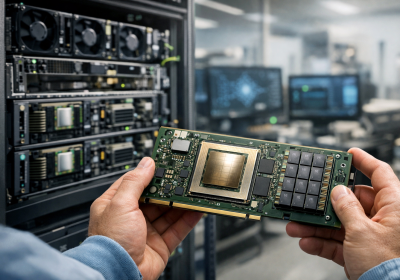

Il continuo dibattito sull’AI Act, la legislazione europea che regola l’intelligenza artificiale, ha subito un importante stop. Il 29 aprile scorso, dopo dodici ore di discussioni intense, i negoziatori dell’Unione Europea non sono riusciti a trovare un punto d’intesa sull’AI Act, né sulle misure di semplificazione indicate dalla Commissione. L’accordo è stato rinviato a maggio, e se entro il 2 agosto 2026 non verrà raggiunto un compromesso, le normative sui sistemi di AI considerati ad alto rischio verranno applicate nella loro forma originaria.

Scadenze e obblighi da rispettare

Con l’entrata in vigore dell’AI Act, prevista per agosto 2024, le aziende dovranno affrontare requisiti molto stringenti per i sistemi AI ad alto rischio. Questi includono ambiti come la biometria, le infrastrutture critiche, l’istruzione e l’applicazione della legge. Le nuove normative comporteranno significativi impegni burocratici per le aziende, che dovranno fornire documentazione tecnica, valutazioni di conformità e gestire i rischi post-mercato. In particolare, il dibattito si è incentrato su un’esenzione proposta dal Parlamento per i sistemi già regolati da normative settoriali, come macchinari e dispositivi medici, al fine di evitare una doppia compliance. Tuttavia, tale proposta ha diviso gli stati membri. Alcuni la vedono come un’opportunità per facilitare le operazioni aziendali, mentre altri temono che possa compromettere le già esistenti protezioni.

Un clima di incertezza per le aziende

Il fallimento dei negoziati porta a scenario complesso per le aziende. Da un lato, le normative originali rimangono in vigore, dando certezza agli investimenti già effettuati. Dall’altro, c’è un clima di incertezza regolatoria, con le imprese che navigano in acque agitate, non sapendo se le regole potrebbero essere alleggerite o mantenute rigorose. Questa indeterminatezza è particolarmente penalizzante per le aziende italiane che lavorano con tecnologie AI integrate in prodotti soggetti a normative già esistenti. La questione della doppia compliance è stata sollevata a più riprese, in particolare dalle imprese che si trovano a dover affrontare sia le leggi europee che quelle italiane, rendendo la situazione ancora più complessa per i Chief Information Officer (CIO).

Il confronto tra protezione e competitività

Stiamo assistendo a un dibattito acceso sull’equilibrio tra la necessità di proteggere i diritti fondamentali e il desiderio di garantire la competitività delle aziende europee sul mercato globale. Le aziende temono di rimanere indietro rispetto ai concorrenti statunitensi e asiatici, che, grazie a una regolamentazione meno severa, possono investire massicciamente nello sviluppo di tecnologie AI avanzate. Tuttavia, le normative previste dall’AI Act sono fondamentali per assicurare diritti come la trasparenza e il controllo umano. Un compromesso potrebbe essere rappresentato da esenzioni calibrate che riconoscano normativi già esistenti evitando di ridurre le protezioni poste a tutela dei cittadini.

Conclusione: prepararsi a un futuro incerto

Indipendentemente dall’andamento delle trattative a Bruxelles, le aziende non possono permettersi di rimanere inattive. La compliance è cruciale e dovrà essere implementata anche senza una chiara direzione politica. Le scadenze stabilite dall’AI Act rimangono in vigore, e lo stesso si applica agli obblighi per i sistemi di AI più vulnerabili. È quindi fondamentale che le organizzazioni inizino ad adeguarsi proattivamente alle normative per evitare problemi futuri. In un contesto normativo che si prospetta come un cantiere aperto, caratterizzato da incertezze, la preparazione diventa la chiave per affrontare efficacemente le sfide dell’intelligenza artificiale.