da Hardware Upgrade :

L’attenzione degli appassionati di gaming nelle ultime ore è senza dubbio stata catalizzata dall’architettura Ada Lovelace e dall’annuncio delle schede GeForce RTX 4090 e 4080. L’evento ha però riservato molto altro, tra cui l’annuncio che NVIDIA H100, l’acceleratore di intelligenza artificiale svelato ad aprile, è in piena produzione. Nel mese di ottobre i partner di NVIDIA inizieranno a portare sul mercato la prima ondata di prodotti e servizi basati sull’architettura Hopper.

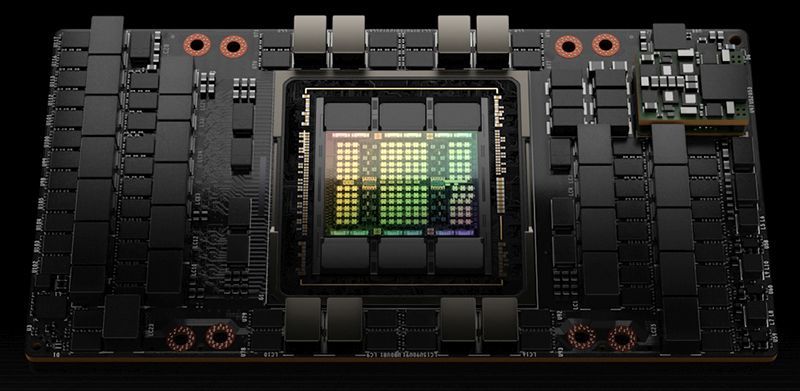

Il chip Hopper a bordo di H100 integra 80 miliardi di transistor e prevede tantissime novità dirette al mondo dell’IA come il Transformer Engine, le istruzioni DPX e molto altro ancora, aspetti che potete approfondire in questo articolo. Secondo NVIDIA, Hopper permette alle aziende di abbattere i costi d’implementazione dell’intelligenza artificiale offrendo le stesse prestazioni della generazione Ampere ma con grandi vantaggi: un’efficienza energetica 3,5 volte maggiore, una riduzione del TCO (costo di possesso totale) di 3 volte e riducendo di 5 volte i nodi nell’infrastruttura server.

I clienti possono provare da subito la tecnologia grazie ai server Dell PowerEdge con H100 disponibili tramite NVIDIA LaunchPad, inoltre sono stati aperti gli ordini per i sistemi DGX H100, che al loro interno prevedono otto GPU H100 connessi tra loro dalla quarta generazione di NVLink per assicurare 32 petaflops di prestazioni con calcoli IA (FP8). A bordo anche una CPU Intel Sapphire Rapids. In tal senso si registra un ritardo: le consegne erano inizialmente previste per il Q3, ma avverranno effettivamente nel Q1 2023, forse proprio per dare tempo a Intel di realizzare i microprocessori.

I principali produttori server, a partire dalle prossime settimane, inizieranno a portare sul mercato una cinquantina di server, con diverse altre dozzine previste nel 2023. Tra i partner abbiamo Atos, Cisco, Dell Technologies, Fujitsu, GIGABYTE, Hewlett Packard Enterprise, Lenovo e Supermicro.

I centri di ricerca come Barcelona Supercomputing Center, Los Alamos National Lab, Swiss National Supercomputing Centre (CSCS), Texas Advanced Computing Center e University of Tsukuba hanno annunciato che includeranno l’acceleratore H100 nei loro futuri supercomputer. Per quanto riguarda il mondo dei servizi cloud, NVIDIA ha annunciato che Amazon Web Services, Google Cloud, Microsoft Azure e Oracle Cloud saranno tra i primi a offrire istanze basate su H100 a partire dal prossimo anno.

Nessuna parola, ovviamente, sull’esportazione degli acceleratori di intelligenza artificiale H100 in Cina, impedita dal governo USA in assenza di un’esplicita autorizzazione.