I Rischi Nascosti della Shadow AI nelle Aziende Con l'aumento della disponibilità degli strumenti di intelligenza artificiale, molti dipendenti iniziano a utilizzare queste tecnologie senza il consenso dei reparti IT e di sicurezza. Sebbene tali strumenti possano migliorare l’efficienza e…

I Rischi Nascosti della Shadow AI nelle Aziende

Con l’aumento della disponibilità degli strumenti di intelligenza artificiale, molti dipendenti iniziano a utilizzare queste tecnologie senza il consenso dei reparti IT e di sicurezza. Sebbene tali strumenti possano migliorare l’efficienza e automatizzare le attività, il loro impiego non autorizzato crea visibili vulnerabilità. Questo fenomeno, conosciuto come “shadow AI”, va oltre il mondo del software non approvato: si tratta di sistemi che elaborano, generano e memorizzano dati sensibili, esponendo le aziende a rischi emergenti che non sono ancora ben gestiti.

Perché la Shadow AI si Diffonde così Velocemente

Il fenomeno della shadow AI sta crescendo rapidamente, grazie alla sua facile accessibilità e utilità immediata. A differenza dei software tradizionali, molti strumenti di AI richiedono pochissima o nessuna configurazione, consentendo ai dipendenti di iniziare a utilizzarli senza ritardi. Secondo una recente ricerca, il 55% dei lavoratori ricorre a strumenti di AI non ufficialmente approvati dalle loro aziende. Questa diffusione è alimentata dalla mancanza di politiche chiare sull’uso dell’AI all’interno delle organizzazioni, costringendo i dipendenti a prendere decisioni autonome, spesso senza considerare le implicazioni di sicurezza.

Utilizzando strumenti di intelligenza artificiale generativa come ChatGPT o Claude, i dipendenti possono condividere involontariamente dati sensibili, grazie a flussi di lavoro più agili, mettendo a rischio la privacy e la sicurezza delle informazioni aziendali. Ogni volta che un dipendente integra un’API di AI o un modello di terze parti senza una revisione formale della sicurezza, il rischio aumenta, con potenziali conseguenze devastanti.

I Rischi per la Sicurezza Associati alla Shadow AI

La shadow AI rappresenta un problema non solo di governance, ma soprattutto di sicurezza. Mentre la shadow IT si concentra sull’uso di software non autorizzato, la shadow AI coinvolge sistemi che gestiscono attivamente dati oltre i confini delle politiche di sicurezza, amplificando il rischio di esposizione e di uso improprio delle informazioni aziendali.

Possibili Fughe di Dati Incontrollate

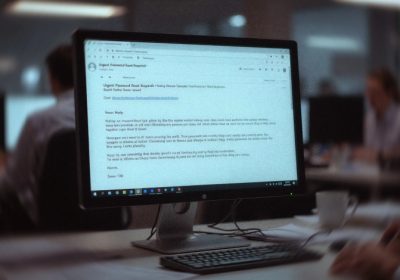

I dipendenti potrebbero accidentalmente condividere dati sensibili, come informazioni sui clienti o documenti commerciali interni, utilizzando strumenti AI per completare compiti. Situazioni in cui vengono inseriti script contenenti chiavi API o credenziali di database pongono il rischio di esposizioni di dati, poiché, una volta che questi lasciano i confini aziendali, diventa difficile monitorarne l’uso. Questo scenario può anche comportare violazioni delle normative come il GDPR, in caso di trasferimenti non autorizzati.

Amplificazione della Superficie di Attacco

Ogni nuovo strumento di AI che viene adottato rappresenta un potenziale vettore di attacco per i criminali informatici. L’uso di strumenti non verificati può introdurre API o plugin vulnerabili. L’accesso a sistemi tramite account personali consente attività al di fuori delle misure di sicurezza aziendale, aumentando il rischio di attacchi.

Controlli di Sicurezza Inadeguati

I controlli di sicurezza tradizionali non sono stati progettati per affrontare l’attuale utilizzo dell’AI. La maggior parte delle piattaforme AI opera tramite HTTPS, rendendo difficile l’ispezione dei contenuti delle interazioni senza strumenti avanzati di ispezione SSL, che non tutte le aziende hanno implementato. Inoltre, le interfacce conversazionali dell’AI possono sfuggire alle rilevazioni degli strumenti di sicurezza, permettendo la condivisione di dati senza generare avvisi.

Come Affrontare i Rischi della Shadow AI

Per ridurre i rischi associati alla shadow AI, le aziende italiane devono passare da un approccio di blocco a uno di gestione attiva degli strumenti AI. Le linee guida ben definite possono ridurre significativamente i pericoli. Ecco alcune strategie pratiche:

- Politiche Chiare di Utilizzo dell’AI: Stabilire quali strumenti sono consentiti e quali tipi di dati possono essere condivisi.

- Alternative AI Approvate: Fornire strumenti di AI sicuri e approvati per ridurre la necessità di soluzioni non autorizzate.

- Monitoraggio dell’Uso dell’AI: Controllare il traffico di rete e le attività API per comprendere meglio come vengono utilizzati questi strumenti.

- Formazione dei Dipendenti: Educare i lavoratori sui rischi associati all’uso dell’AI e sulla gestione dei dati suscettibili.

Conclusione

Con l’adattamento crescente dell’AI nei luoghi di lavoro, un certo grado di shadow AI è inevitabile. Le aziende devono dunque concentrarsi sul rendere l’uso di questi strumenti sicuro, sviluppando politiche efficaci e garantendo una buona governance delle identità. Solo così sarà possibile sfruttare appieno i benefici dell’AI senza compromettere la sicurezza aziendale.